1950년 수학자 앨런 튜링이 제안한 인공지능 판별법 튜링 테스트는 “기계도 생각할 수 있을까?(Can machines think?)”라는 질문에서부터 출발합니다. 이때부터 컴퓨터의 인간 지능을 향한 도전이 시작되었는데요. 그리고 70년이 지난 지금, 기술의 발달로 컴퓨터는 인간처럼 사고할 수 있을 뿐만 아니라 감정을 인식하고 표현하는 단계까지 진화했습니다. 이제는 “기계도 생각할 수 있을까”를 물을 게 아니라 “기계와 사랑을 나눌 수 있을까”를 질문해야 하는 새로운 패러다임 속에 있는 것입니다.

인공지능은 우리의 일상생활까지 깊숙이 스며들어 ‘ARTIFICIAL INTIMACY’라는 인간과 기계 사이의 새로운 관계를 형성하기에 이르렀습니다. 인간과 기계 사이의 친밀함이 생겼음을 표현하는 이 새로운 용어(ARTIFICIAL INTIMACY)는 서로가 감정 교류를 하기 시작했다는 사실 그 자체보다는 기술의 발달로 기계가 점점 더 많이 인간의 정보를 취득하게 되면서 우리의 삶에 밀접한 영향을 끼칠 만큼 가까워졌다는 것을 의미합니다.

지난 1월, 아스펜 연구소(The Aspen Institute)는 ‘ARTIFICIAL INTIMACY’를 주제로 라운드 테이블을 진행했습니다. 이 자리에는 엔씨소프트 Global CSO 윤송이 사장을 비롯해 AI 기업가 톰 그루버(Tom Gruber), 홍콩과학기술대(HKUST)의 더 카이 우(De Kai Wu) 교수, 그리고 매사추세츠 공과대학(MIT) 셰리 터클(Sherry Turkle) 석좌교수 등 25명의 산업계∙학계∙시민사회 전문가들이 모여 인간-기계의 친밀한 관계를 유지하면서도 인간이 좀 더 인간적으로 살아갈 수 있도록 하는 방법에 대해 여러 의견을 나누었습니다.

[아래 본문은 라운드테이블에서 논의된 내용을 토대로 2020년 4월 14일 ASPEN DIGITAL에서 발간한 Kristine Gloria 박사의 보고서 < ARTIFICIAL INTIMACY > 중 AI를 둘러싼 사회적 문제와 이를 위한 규범에 대해 여러 전문가들이 논의한 내용을 일부 발췌하여 정리한 것입니다. 원본은 이곳에서 확인 바랍니다.]

공감은 인간 고유의 능력인가

1909년 심리학자 에드워드 티치너(Edward B. Titchener)가 도입한 용어 ‘공감(Empathy)’은 ‘감정이입’을 뜻하는 독일어 'Einfühlung'에서 기원했습니다. 공감은 타인의 감정을 인지하는 것에 그치는 것이 아니라 나아가 그 감정에 부합하는 감정을 나타내 보이거나, 상대방의 감정과 나의 감정을 일치시켜 공유하는 능력을 뜻합니다. 인간은 생존에 있어 타인과 관계를 유지하는 사회성이 중요했고, 오랜 진화 과정을 통해 타인의 의도를 파악하고 공감할 수 있도록 발전해왔습니다.

도덕철학에서 공감은 인간을 사회적이고 도덕적으로 만드는 핵심적인 요소입니다. MIT의 셰리 터클 교수는 공감을 관계적이고 상대적인 개념이라고 소개합니다. 인간은 자신이 얼마나 다른 사람을 알지 못하는지 깨닫게 되면서 상대방에게 특별한 관심을 가지고, 세심히 관찰하면서 공감을 배우게 된다는 것입니다.

공감은 개인의 성장과 더불어 사회 구조를 형성하는 데에도 중요한 역할을 합니다. 인간은 공감을 통해 유대를 이루고 단단한 관계를 형성합니다. < Empathy and Moral Development >의 저자 마틴 호프먼(Martin Hoffman)은 공감 능력이 없다면 인간은 사회적인 의무와 개인적인 욕구 사이에서 타협할 수 없을 것이라고 말했습니다.

공감 능력은 나이가 들거나, 두려움 또는 외로움과 같은 감정을 느끼는 인간의 삶 속에서 길러집니다. 하지만, 셰리 터클 교수는 인간이 기계에게 느끼는 친밀감이 공감의 기능을 위협하고 있다고 말했습니다.

감정은 인간 고유의 영역이라 여겨졌지만 현재 컴퓨터는 감정을 인식하거나 표현할 수 있습니다. 공감 능력이 개인의 성장과 사회구조 형성에 중요한 역할을 한다면, 인공적으로 만들어진 공감이 이 역할을 대신할 경우 사회와 개인에 어떤 영향을 미칠지 깊이 생각해 봐야 합니다.

인간과 ‘교감’하는 AI의 탄생

심리 치료 로봇 PARO의 사례는 기계가 사람만큼이나 감정을 인식하고 느낄 수 있다는 것을 보여줍니다. 셰리 터클 교수는 자녀를 잃은 한 여성이 이 로봇에게 위로를 받았던 경험을 공유했습니다.

PARO는 이용자와의 상호작용에 따라 놀람, 행복, 화 같은 감정들을 표현하는 로봇입니다. 쓰다듬으면 꼬리를 흔들고 눈을 깜빡 거리기도 합니다. 또한 주인을 기쁘게 하는 방향으로 행동하는 걸 학습하고 그 행동들을 반복하기도 합니다.

셰리 터클 교수는 자녀를 잃은 중년 여성과 PARO가 대화하는 장면을 이야기했습니다. 이 대화에서 PARO는 많은 것을 하지 않았지만, 중년 여성은 PARO가 그녀를 위해 슬퍼하고 그녀를 위로하고 있다고 느꼈습니다. 셰릴 터클 교수는 중년 여성이 PARO가 자신을 위해 슬픔을 느꼈다고 믿은 것과 나아가 PARO를 위로와 도움이 필요한 존재인 것처럼 반응한 데에 주목했습니다.

*파로(PARO): 일본 산업기술총합연구소(AIST)에서 개발한 아기 하프물범(Harp Seal) 모양의 로봇이다. 인간과 동물 간의 유대감을 이용하여 사람이 아기를 안았을 때의 감정을 느낄 수 있도록 디자인되었다. 치매 환자 치료 목적으로 개발하였는데 우울증, 인지장애, 발달장애와 같은 증상 완화에도 효과적인 것으로 평가받아 2009년에는 미국에서 의료기기로 허가 받았다

인간의 본능은 공감을 통해 진화해 왔습니다. 본능적으로 인간은 사물이 감정을 가지지 않았음에도 그것을 의인화해 인격을 가진 존재처럼 대합니다. 이런 속성 때문에 인간은 로봇과 교감한다고 생각할 수 있습니다.

실제 인간 사이의 관계는 기계와 같이 단순하지 않아서 변수가 많습니다. 그런 인간과의 소통보다는 언제든 대화가 가능한 기계와의 소통이 편리하다고 느낄 수 있습니다. 이런 대화에 자주 노출된다면 인간은 기계와 사이에서 생긴 인공적인 공감에 쉽게 빠질 수 있습니다. PARO와 같이 감정적인 반응을 이끌어 내도록 설계된 로봇과의 공감은 인간의 정신적인 취약점을 건드리기 쉽습니다. 인간은 자신도 모르는 사이 이 사교적인 로봇에 깊은 애착을 느낄 수 있습니다.

하지만 인공 지능은 데이터를 통해 출력되는 하나의 알고리즘입니다. 컴퓨터는 인간의 감정을 인식할 수 있지만 이해했다고 보기는 힘듭니다. 기계는 인간들이 관계에서 느끼는 사랑, 우정, 상실 등의 감정을 경험해 본 적이 없기 때문입니다.

셰리 터클 교수는 인간과의 소통이 기계와의 교감으로 대체되지 않도록 주의해야 한다고 말합니다. 기술의 발달로 기계와 소통하는 빈도는 점점 늘어날 것입니다. 그리고 이 관계는 감정을 기반으로 점점 더 친밀해질 것입니다. 그녀는 인간이 기계에 정신적, 감정적으로 의존하게 되면 이에 따라 어떤 새로운 양상이 나타날지 주의 깊게 지켜봐야 한다고 말했습니다.

“여러분 한 사람 한 사람이 모두 AI 입니다”

창의력(Creativity), 감정 인식(Emotion Recognition), 그리고 동정심(Sympathy)은 이제 더 이상 인간 고유의 영역이 아닙니다. 현시대의 AI가 인간의 능력을 구현하고 있기 때문입니다. 일례로 자동 감정 인식 기술은 표정, 억양, 그리고 어휘와 같은 다양한 데이터로 정확도를 높이고 있습니다. 홍콩과학기술대(HKUST)의 더 카이 우 교수에 따르면 인간과 기계는 더 이상 크게 다르지 않으며 심지어 “여러분, 한 사람 한 사람이 모두 AI입니다.”라고 표현하기도 합니다.

과거에 경험하지 못했던 새로운 유형의 관계는 다양한 윤리적, 사회적 문제를 노출시킵니다. 직면하게 될 문제가 무엇인지 주의를 기울여 탐색할 필요가 있습니다. 엔씨소프트 Global CSO 윤송이 사장은 어떤 결과물이 단순히 컴퓨터나 알고리즘 계산에 의한 것이라는 이유만으로 그것이 더 정확하고, 정의롭고, 도덕적일 것이라고 생각하는 경향이 있다고 말했습니다. 그녀는 기계의 역할과 기능에, 우리가 인간관계에서 기대하는 신뢰, 공감, 도덕규범의 수준까지 바라면 안 된다고 강조했습니다.

기계와 사람이 감정적으로 소통하는 것은 인류가 처음 겪는 일입니다. 이런 소통은 새로운 문제들을 야기할 수 있습니다. 예를 들어, 기업에서 AI를 이용해 마음을 이끄는 상호작용을 의도적으로 만들어 낼 수 있습니다. 이 과정에서 기업은 자연스럽게 소비자의 개인 정보를 빼낼 수도 있습니다. 또, 기계와의 친밀함이 더 이상 낯설지 않은 젊은 세대들의 정신 건강을 해칠 우려도 존재합니다.

윤송이 사장은 인간이 인지적 공감 능력을 지닌 AI와 새로운 관계를 형성해야 할 시기에 직면했음을 알렸습니다. 하지만, 이 관계에 반드시 현재 사회에 통용되는 도덕적 기준을 적용할 필요는 없다고 말했습니다.

*인지적 공감(Cognitive Empathy): 객관적으로 상대방의 감정과 생각을 인지하는 능력

인간과 기계의 공생을 위한 새로운 접근 방식 – 철학적, 시적, 정책적 관점에서

우리는 인공지능이 공감의 기능까지 넘보는 새로운 패러다임 속에 있습니다. 미래 사회에 인간과 기계의 관계를 어떻게 재구성할지 진지하게 고민해야 할 때이며, 다양한 관점의 새로운 사고방식에서 이 문제를 접근해야 합니다.

이제 이 관계를 철학적, 시적, 그리고 정책적 관점에서 살펴보려고 합니다. 인공적인 친밀함(ARTIFICIAL INTIMACY)을 개인의 경험에 국한시키지 않고 현실 세계에 연결해 볼 것입니다. 이런 접근이 사회에 노출된 다양한 위험을 감지하고 문제를 해결하기 위한 출발점을 제공할 수 있을 것입니다.

관점에 따라 AI는 달라진다

AI에 대한 어떤 논의도 인식론적인 관점에서 시도된 적이 없습니다. 만약 전통적인 유럽인의 사고방식 - 사람은 지능을 가지고, 동물은 본능을 가지고, 기계는 메커니즘으로 작동하는 – 이 잘못 판단한 것이라면 어떻게 될까요.

Transformations of the Human(Berggruen Institute)의 디렉터, 토비어스 리스(Tobias Rees)는 인공지능과 기계를 구분하는 것, 인간과 기계를 구분하는 건 큰 의미가 없다고 이야기합니다. 이런 구분은 예외주의(exceptionalism)의 시각에서 서로를 그룹화한 것이라고 말합니다. 그는 이런 구분이 ‘인간에게 도움이 되는 기계’를 만드는 데 생각의 한계를 가져올 뿐이라고 말했습니다. 토비어스 리스는 기업들이 인간과 기계의 명확한 경계선을 없애는 방식으로 기술을 발전시킨다면 다양한 분야에 AI를 활용할 기회가 열려 있을 것이라고 말했습니다.

토비어스 리스와 다른 참가자들은 동양철학의 관점, 도교나 유교적인 관점을 고려해야 한다는 의견을 제시했습니다. 서양과 동양은 근본적인 사고방식의 차이를 가지고 있습니다. 예를 들어, 동양은 상호주의보다는 집단주의적 성향을 띠는 것처럼 말입니다.

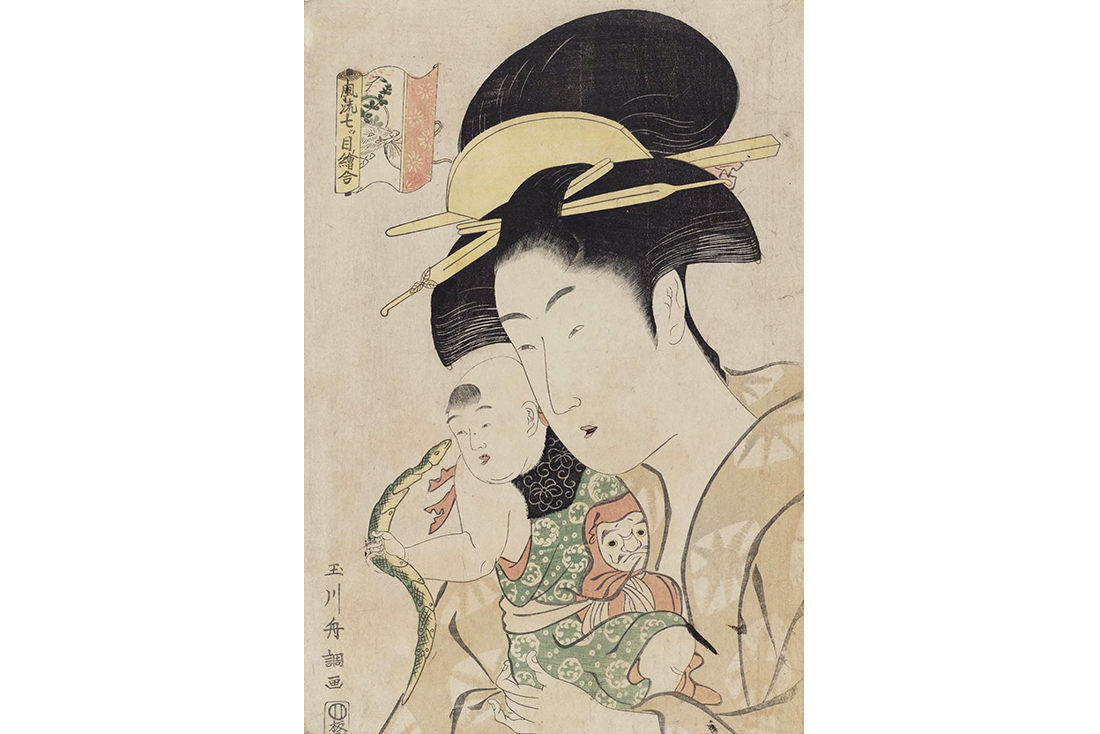

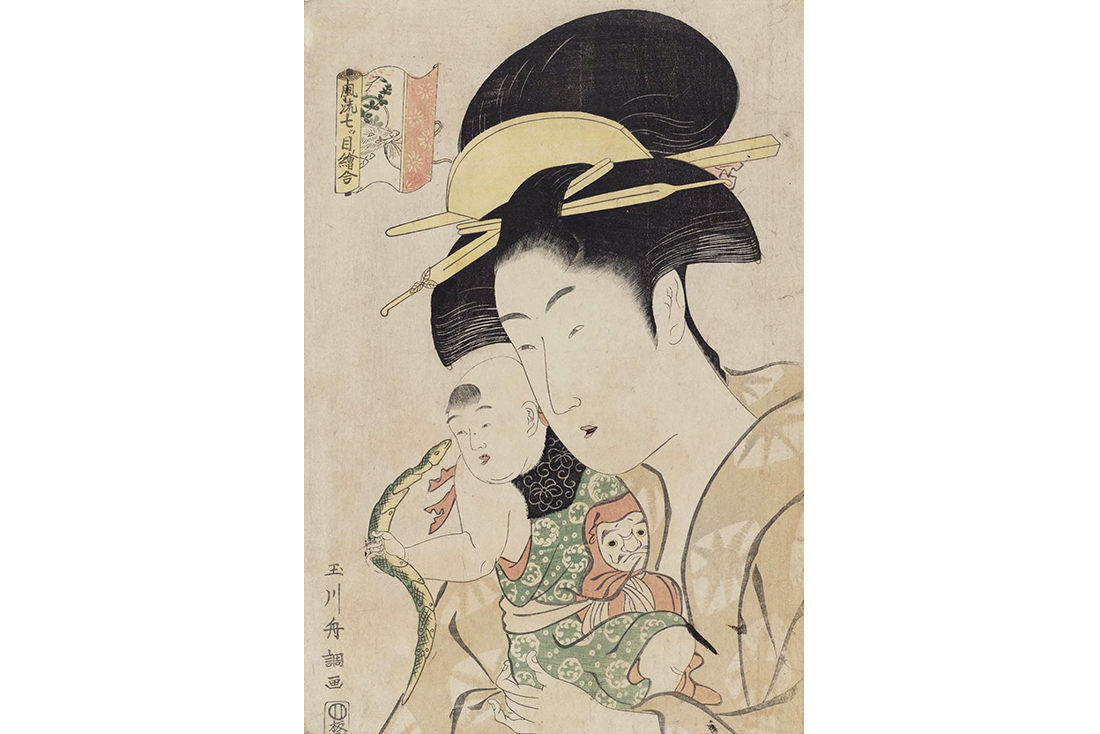

이를 주제로 도쿄 대학의 나가이 유키에(Yukie Nagai) 교수의 프로젝트가 소개되었습니다. 일본을 비롯한 동아시아 국가에서 AI와 로봇을 이용한 데이터 시각화를 어떻게 진행하는지 연구한 것이었습니다. 연구 결과 서양은 인간 대 비인간, 인간 대 AI/로봇으로 개체를 각기 따로 떼어서 보는 반면, 도교의 영향을 많이 받은 동양은 두 개체 사이의 연속성을 강조하도록 묘사하는 것을 알 수 있었다고 합니다.

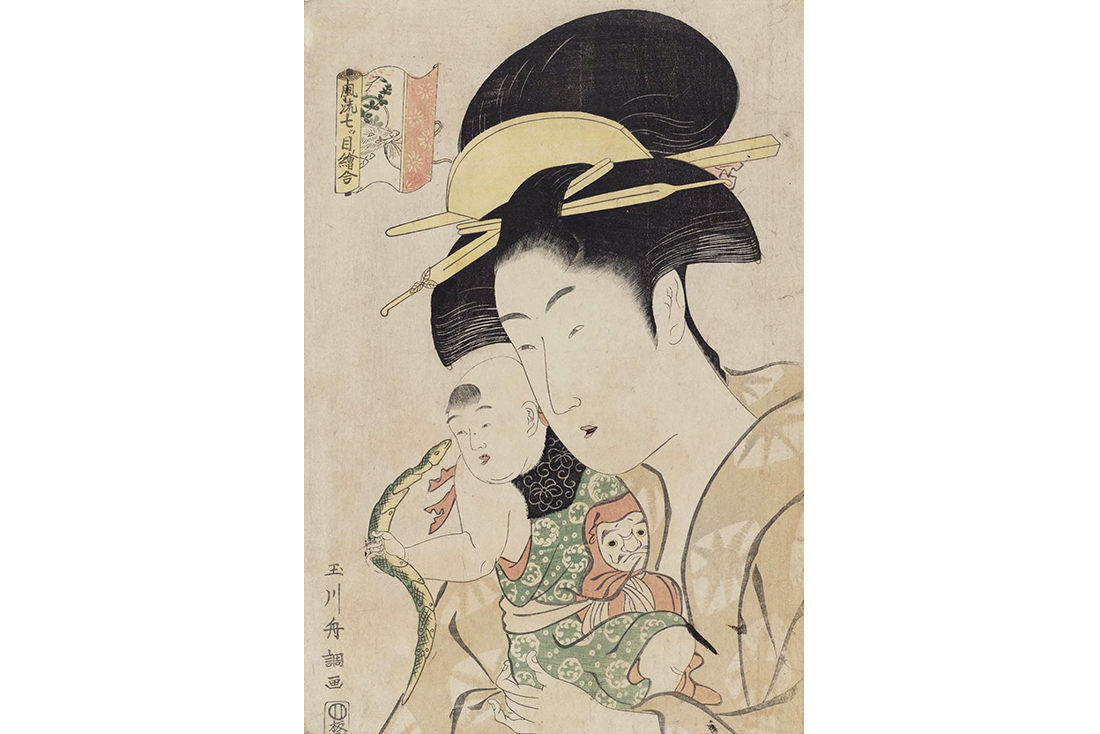

위 사진은 일본 전통적인 목판화인 우키요에 그림입니다. 이 사진에서 엄마와 아이는 같은 방향을 바라보고 있습니다. 반면에 서양권 그림을 살펴보면 엄마와 아이가 서로를 마주 보고 있는 모습을 자주 발견할 수 있습니다. 이런 문화적 차이는 인간 사이의 관계에서 나아가 인간이 기계를 받아들이는 방식에서도 다름이 나타날 수 있습니다.

또한 인공지능은 데이터의 편향을 그대로 나타냅니다. 관점의 차이를 담은 데이터들은 그대로 인공지능에 투영될 가능성이 있습니다. 앞으로 인공지능 기술의 발전에 있어 제공자와 수용자 모두 어떤 관점을 고려해서 기계를 개발하고 받아들여야 하는지 고민해야 합니다. 그리고 이런 철학적 관점에서의 고민이 기술의 발전 속도보다 너무 늦어지면 안 될 것입니다.

AI의 새로운 가능성, Big Mother

AI는 앞으로 어떤 역할을 해야 할까요. 우리는 답을 찾기 위해 ‘시’에서 힌트를 얻을 수 있습니다. 이탈리아의 소설가 움베르토 에코는 “이론화할 수 없는 것을 우리는 이야기로 풀어내야 한다.”라고 말하기도 했습니다.

메타포를 설정하는 것은 AI를 설계하고 적용하는 데 강력한 도구가 될 수 있습니다. 유명한 예로 ’빅 브라더(Big Brother)’ AI가 있습니다. 일상생활에 밀접하게 연결된 AI는 조지 오웰의 소설 < 1984 >에 등장하는 사생활 감시체계인 ‘빅 브라더’를 연상시킵니다. 이 ‘빅 브라더’ AI는 개인을 감시하거나 초개인화(hyper-personalization)를 통해 행동을 조작할 수 있는 강력한 권력을 표현합니다. 이런 AI는 기관에 모든 권력을 종속시킬 수 있습니다.

그러나 애플 ‘시리’의 공동 제작자이자 AI 기업가 톰 그루버(Tom Gruber)는, AI의 새로운 역할은 인간이 더 나은 사람이 되도록 돕는 것이라고 강조했습니다. 그리고 ‘빅 브라더’에 대비되는 개념이자 AI의 지향점으로 ‘빅 마더(Big Mother)’라는 하나의 메타포를 제시했습니다. ‘빅 마더’로서 AI는 감시 대신 자기 인식(self-awareness), 자기 돌봄(self-nurturing), 자기 관리(self-care) 및 독립성(independence)의 개념을 우선시하여 인류의 부족한 점을 채워주고 또 보호합니다.

이런 ‘빅 마더’ AI는 인간이 좀 더 명확하게 생각할 수 있도록 돕고, 사생활과 관련된 개인 정보를 노출하지 않도록 하면서 ‘빅 브라더’ AI로부터 인간을 보호해 줄 것입니다. 즉, AI의 새로운 상(像)은 인간이 가장 인간답게 살 수 있도록 돕는 ‘빅 마더’일 것입니다.

기계와의 친밀함 속에서 인간 스스로를 지키는 법

AI의 역할이 ‘빅 마더’와 같은 긍정적인 모델로 전환되기 위해선 정책적, 법적, 경제적인 부분도 함께 고려되어야 합니다. 최근 인공지능 기술이 지닌 잠재적인 위험에 문제의식을 느끼고 정부나 기업에서 AI의 윤리적 가이드라인을 수립하고 있습니다.

인간과 상호작용을 하도록 설계된 기계들은 매일 엄청난 양의 정보를 캡처합니다. E-mail 계정을 통해 구글과 공유한 정보의 양, 또는 아마존 알렉사의 음성 명령을 통한 개인용 데이터의 양은 놀라울 정도로 많습니다. 기계와 인간의 친밀감이 강할수록 데이터는 더 많이 축적됩니다. 기계와 상호작용을 통해 쌓이는 데이터는 일반적으로 유해하지 않다고 여겨집니다. 하지만, 감정을 교류한다는 미명 하에 의도성이 들어간다면 사생활을 침범했을 때 생길 수 있는 문제나 개인의 인격을 침해하는 문제가 표면화될 수 있습니다.

또한 이 문제가 경제적으로도 이용될 수 있다는 점을 경계해야 합니다. 기업들은 의도적으로 친밀감을 형성해 사용자들을 조종하거나 민감한 정보를 착취할 수도 있습니다. 기업은 이용자가 AI에게 느끼는 일방적인 감정에서 형성된 유착 관계를 이용하여 수익을 창출할 수도 있습니다.

이러한 상황에 대해 윤송이 사장은 “우리는 인간의 공감 능력이 제3자의 상업적 목적에 이용되는 것을 원치 않습니다. 그렇기 때문에 스스로 인공지능의 사용에 대해 의식하고 무분별한 사용을 경계해야 하며, 더 나아가 이러한 환경 속에서 우리 스스로를 보호할 수 있는 정책적인 가이드라인 개발이 필요합니다.”라고 말하며 인간과 AI의 공존을 위한 사회적 논의와 합의의 중요성을 역설했습니다.

이 토론을 진행한 아스펜 연구소(The Aspen Institute)는 워싱턴 DC에 본사를 둔 교육 및 정책 연구기관입니다. 전 세계 젊은 리더들과 함께 문제 분석, 합의 도출 등 아이디어를 서로 공유하고 해결책을 모색합니다. 사회, 정치, 문화, 예술, 기술 등 다양한 주제를 다루며 참가자 간 대화와 토론(dialogue & discussion)을 중시하는 문화가 특징입니다.

Dr. Kristine Gloria, ”Artificial Intimacy,” The Aspen Institute Roundtable on Artificial Intelligence.

Facebook

Facebook  KakaoTalk

KakaoTalk  LinkedIn

LinkedIn  Email

Email  Copy URL

Copy URL